لقد بذلت جهداً كبيراً في تصميم صورة مصغرة، وكتبت عنواناً تعتقد أنه جذاب للغاية، وبعد النشر — 200 مشاهدة فقط. بينما حساب آخر ينشر محتوى بسيطاً ويحصد 200 ألف مشاهدة.

هذا ليس حظاً، وليس ظلماً من الخوارزمية. إنه علم الانتباه.

دماغك هو آلة تصفية قاسية

وفقاً لدراسة Timothy Wilson في كتابه Strangers to Ourselves (Harvard University Press, 2002)، يستقبل الدماغ البشري حوالي 11 مليون بت من المعلومات الحسية في الثانية، لكن سعة نطاق الانتباه الواعي تبلغ 50 بت/ثانية فقط. وهذا يعني أن 99.9995% من المعلومات يتم التخلص منها قبل أن تدركها حتى.

عندما يتصفح المستخدمون YouTube، أو Xiaohongshu، أو Taobao، يتنافس محتواك مع عشرات المواد الأخرى على تلك الـ 50 بت من الانتباه. وجدت دراسة تتبع العين من MIT Media Lab عام 2019 أن متوسط وقت التحديق في قطعة واحدة من المحتوى في خلاصة (feed) الأجهزة المحمولة يتراوح بين 0.3 و0.5 ثانية فقط.

الطبقات الثلاث لتصفية الانتباه

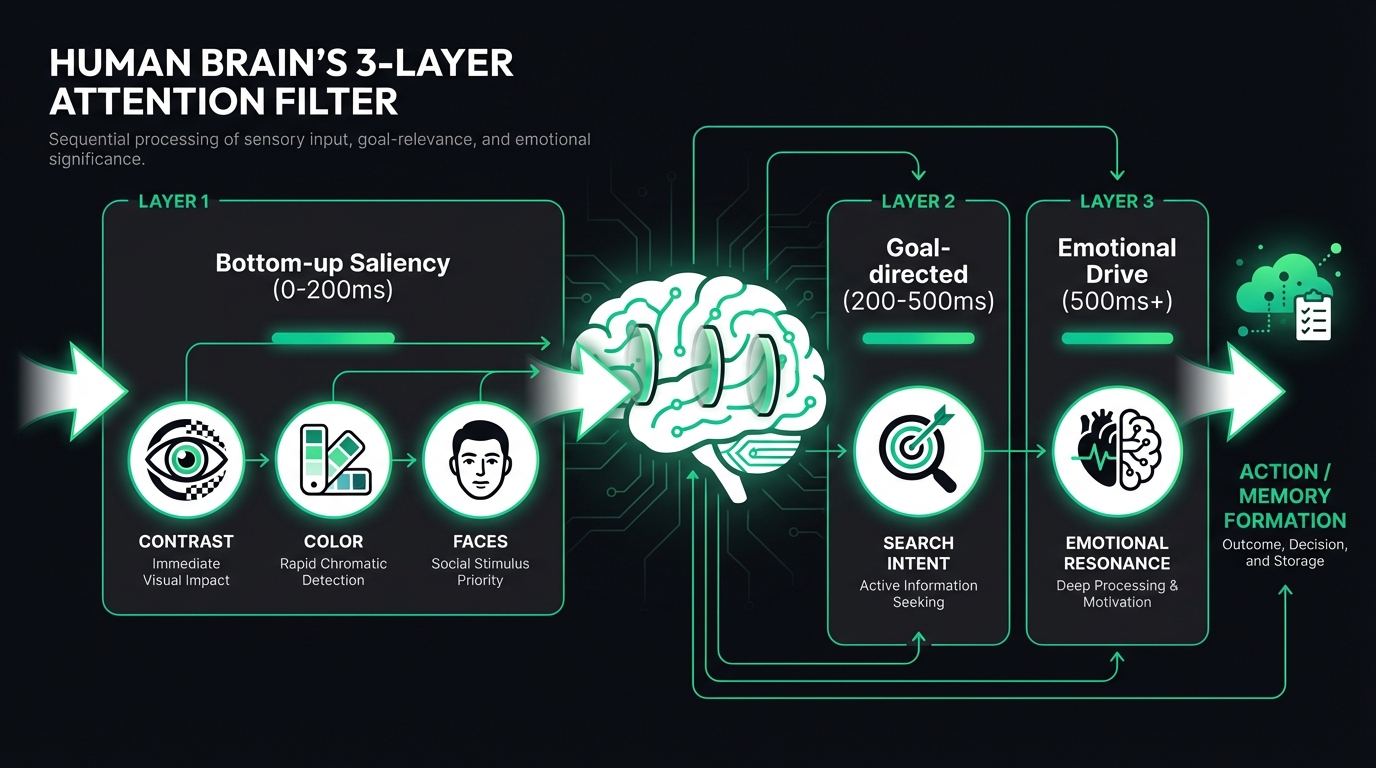

يتبع توزيع الانتباه البصري نموذجاً من ثلاث طبقات:

الطبقة الأولى: البروز الأساسي (0-200 مللي ثانية)

هذه العملية تلقائية ولاواعية تماماً. وفقاً للورقة البحثية الكلاسيكية Computational modelling of visual attention التي نشرها Laurent Itti و Christof Koch في Nature Reviews Neuroscience (2001)، تستجيب القشرة البصرية للدماغ (المناطق V1-V4) تلقائياً لـ التباين العالي، الألوان الزاهية، الوجوه البشرية، والحركة. هذا ليس اختياراً، بل غريزة.

بيانات فعلية: أظهر تحليل FlowDx لأكثر من 12,000 صورة مصغرة أن الصور التي تحتوي على وجوه بشرية تحصل على درجة انتباه أعلى بنسبة 47%، بينما الصور التي تستخدم مجموعات ألوان عالية التباين تتفوق بنسبة 38%.

الطبقة الثانية: الانتباه الموجه نحو الهدف (200-500 مللي ثانية)

يتصفح المستخدمون وبداخلهم نية معينة. الشخص الذي يبحث عن "كيفية إنقاص الوزن" سينجذب تلقائياً إلى العناصر البصرية المتعلقة بالتخسيس. تقود هذه الطبقة القشرة أمام الجبهية، وكلما زاد التوافق مع نية البحث، زاد معدل النقر.

الطبقة الثالثة: الدافع العاطفي (أكثر من 500 مللي ثانية)

أثبت Joseph LeDoux في كتابه The Emotional Brain (Simon & Schuster, 1996) أن اللوزة الدماغية يمكنها الاستجابة للمحفزات العاطفية في غضون 170 مللي ثانية تقريباً — أي أسرع مما يمكنك "رؤية" الصورة بوعي. ووجدت دراسة Adolphs وآخرون في Journal of Cognitive Neuroscience (2005) أن هذا التقييم العاطفي السريع يؤثر مباشرة على توزيع الانتباه. المحتوى الذي يثير الفضول، أو الشعور بالاستعجال، أو التعاطف يمر بسهولة أكبر عبر هذه الطبقة.

أكثر خمس "مناطق ميتة" شيوعاً للانتباه

بعد تحليل آلاف المواد ذات معدلات النقر المنخفضة، لخصنا المشكلات الخمس الأكثر شيوعاً:

| المشكلة | تكرار الظهور | التأثير |

|---|---|---|

| ضعف التباين بين النص والخلفية | 67% | العنوان غير قابل للقراءة في الصورة المصغرة |

| فقدان بؤرة التركيز البصري | 54% | العين لا تعرف أين تنظر |

| فرط المعلومات | 43% | عناصر كثيرة جداً تتنافس على الانتباه |

| الوجوه محجوبة أو صغيرة جداً | 38% | فقدان أقوى نقطة ارتكاز للانتباه |

| اندماج الألوان مع خلفية المنصة | 31% | "اختفاء" المحتوى داخل الخلاصة (feed) |

كيف تستخدم FlowDx لتشخيص محتواك

يستخدم FlowDx محرك ذكاء اصطناعي ثلاثي الطبقات لمحاكاة استجابة الدماغ لمحتواك:

- محرك خرائط الحرارة للانتباه — يعتمد على نموذج DeepGaze IIE للتنبؤ بأول مكان تنظر إليه عين المستخدم.

- تحليل التنشيط المعرفي — يقيم شدة تحفيز المحتوى لمناطق الدماغ المختلفة (البصرية، العاطفية، الذاكرة، اتخاذ القرار).

- محرك التشخيص بالذكاء الاصطناعي — تحليل عميق بواسطة نموذج Gemini البصري لتقديم اقتراحات تعديل محددة.

ينتج عن كل تشخيص درجة معرفية خماسية الأبعاد (الانتباه، التركيز البصري، التأثير العاطفي، دافع العمل، قوة الذاكرة)، مع تحديد مناطق المشكلات واتجاهات التعديل.

اختلافات تنافس الانتباه بين المنصات

تختلف حدة التنافس على الانتباه حسب المنصة. فهم هذه الاختلافات أمر حيوي لتحسين المحتوى:

| المنصة | وقت التحديق | كثافة التنافس | نقاط ارتكاز الانتباه الرئيسية |

|---|---|---|---|

| صفحة YouTube الرئيسية | 0.5-1.2 ثانية | 4-8 صور متجاورة | الوجوه + نص عالي التباين |

| خلاصة Xiaohongshu | 0.15-0.3 ثانية | 2-4 صور متجاورة | تشبع الألوان + التنسيق البصري |

| نتائج بحث Taobao | 0.2-0.4 ثانية | 6-10 صور متجاورة | وضوح المنتج + خلفية بيضاء |

| خلاصة Douyin | 1-3 ثوانٍ (فيديو) | صورة واحدة بملء الشاشة | أول 3 ثوانٍ + عناصر ديناميكية |

| 0.3-0.8 ثانية | 1-3 صور | الجمالية البصرية + اتساق العلامة التجارية |

ملاحظة: تختلف أنماط تنافس الانتباه في Douyin و Instagram جذرياً عن المنصات الأخرى — فهي غامرة بملء الشاشة، ويحدث التنافس على "الاستمرار في المشاهدة" بدلاً من "النقر للدخول".

من النظرية إلى التطبيق: 3 خطوات لزيادة الانتباه لمحتواك

بناءً على المبادئ العلمية المذكورة أعلاه، إليك عملية التحسين التي نوصي بها:

- تشخيص الوضع الحالي — ارفع محتواك على FlowDx للحصول على خريطة حرارة الانتباه والتقييم الخماسي لتحديد المشكلات.

- التعديل بناءً على المعايير — اتبع التوصيات الواردة في تقرير التشخيص (تكبير الوجوه، زيادة التباين، تبسيط التنسيق، إلخ).

- التحقق والمقارنة — قم بالتشخيص مرة أخرى بعد التعديل لمقارنة التغير في الدرجات والتأكد من صحة اتجاه التحسين.

تتركز مشكلات الانتباه في معظم المحتويات في 2-3 نقاط أساسية. إصلاح هذه المشكلات الجوهرية يؤدي عادةً إلى زيادة في معدل النقر بنسبة 50-200%.

الأسئلة الشائعة (FAQ)

ما الفرق بين علم الانتباه واختبار A/B؟

يخبرك اختبار A/B "أي نسخة هي الأفضل"، لكنه لا يخبرك "لماذا". أما علم الانتباه، فمن خلال محاكاة عملية المعالجة البصرية في الدماغ، يمكنه التنبؤ قبل النشر بأين سينظر المستخدم وماذا سيتجاهل، ويقدم توجيهات محددة للتعديل. يعمل الاثنان معاً بشكل مثالي: استخدم تحليل الانتباه للتحسين أولاً، ثم اختبار A/B للتحقق.

هل خرائط الحرارة الناتجة عن الذكاء الاصطناعي دقيقة؟

تتجاوز دقة التنبؤ لنموذج DeepGaze IIE المستخدم في FlowDx نسبة 87% (مقياس AUC) في اختبار MIT Saliency Benchmark، وهو أحد أدق نماذج التنبؤ بالانتباه المتاحة حالياً. يعتمد النموذج على شبكات عصبية عميقة DenseNet و ResNeXt، وتم تدريبه على أكثر من مليون بيان حقيقي لتتبع عين البشر.

هل يصلح تحليل الانتباه لجميع أنواع المحتوى؟

تحليل الانتباه هو الأكثر فعالية للصور الثابتة (الصور المصغرة، الأغلفة، الملصقات، المواد الإعلانية، صور المنتجات). بالنسبة لمحتوى الفيديو، يدعم FlowDx التحليل إطاراً بإطار لمساعدتك في العثور على أضعف لحظات الانتباه في الفيديو. المحتوى النصي البحت (مثل عناوين المقالات) ليس ضمن نطاق التحليل الحالي.

ابدأ التشخيص الآن

ارفع صورتك المصغرة أو غلافك أو مادتك الإعلانية إلى FlowDx، واحصل على تقرير تشخيص كامل للانتباه في غضون 30 ثانية. يمكن للمستخدمين المجانيين تجربة الخدمة مرة واحدة.

المراجع

- Wilson, T. D. (2002). Strangers to Ourselves: Discovering the Adaptive Unconscious. Harvard University Press.

- Itti, L., & Koch, C. (2001). Computational modelling of visual attention. Nature Reviews Neuroscience, 2(3), 194-203.

- LeDoux, J. E. (1996). The Emotional Brain. Simon & Schuster.

- Adolphs, R. et al. (2005). A mechanism for impaired fear recognition after amygdala damage. Journal of Cognitive Neuroscience, 17(7), 1039-1050.

- Linardos, A. et al. (2021). DeepGaze IIE: Calibrated prediction in and out-of-domain for state-of-the-art saliency modeling. ICLR 2021.

- Borji, A., & Itti, L. (2013). State-of-the-art in visual attention modeling. IEEE TPAMI, 35(1), 185-207.