Has creado cuidadosamente una miniatura, escrito un título que crees atractivo, lo publicas y... 200 visualizaciones. La cuenta de al lado publica algo al azar y obtiene 200,000.

No es suerte, ni un algoritmo injusto. Es la ciencia de la atención.

Tu cerebro es una máquina de filtrado implacable

Según la investigación de Timothy Wilson en Strangers to Ourselves (Harvard University Press, 2002), el cerebro humano recibe unos 11 millones de bits de información sensorial por segundo, pero el ancho de banda de la atención consciente es de solo 50 bits/segundo. Esto significa que el 99.9995% de la información se descarta antes de que seas consciente de ella.

Cuando los usuarios navegan en YouTube, Instagram o Amazon, tu contenido compite con decenas de otros por esos 50 bits de atención. Un estudio de seguimiento ocular del MIT Media Lab en 2019 encontró que el tiempo promedio de fijación de un usuario en una sola pieza de contenido en el feed móvil es de solo 0.3 a 0.5 segundos.

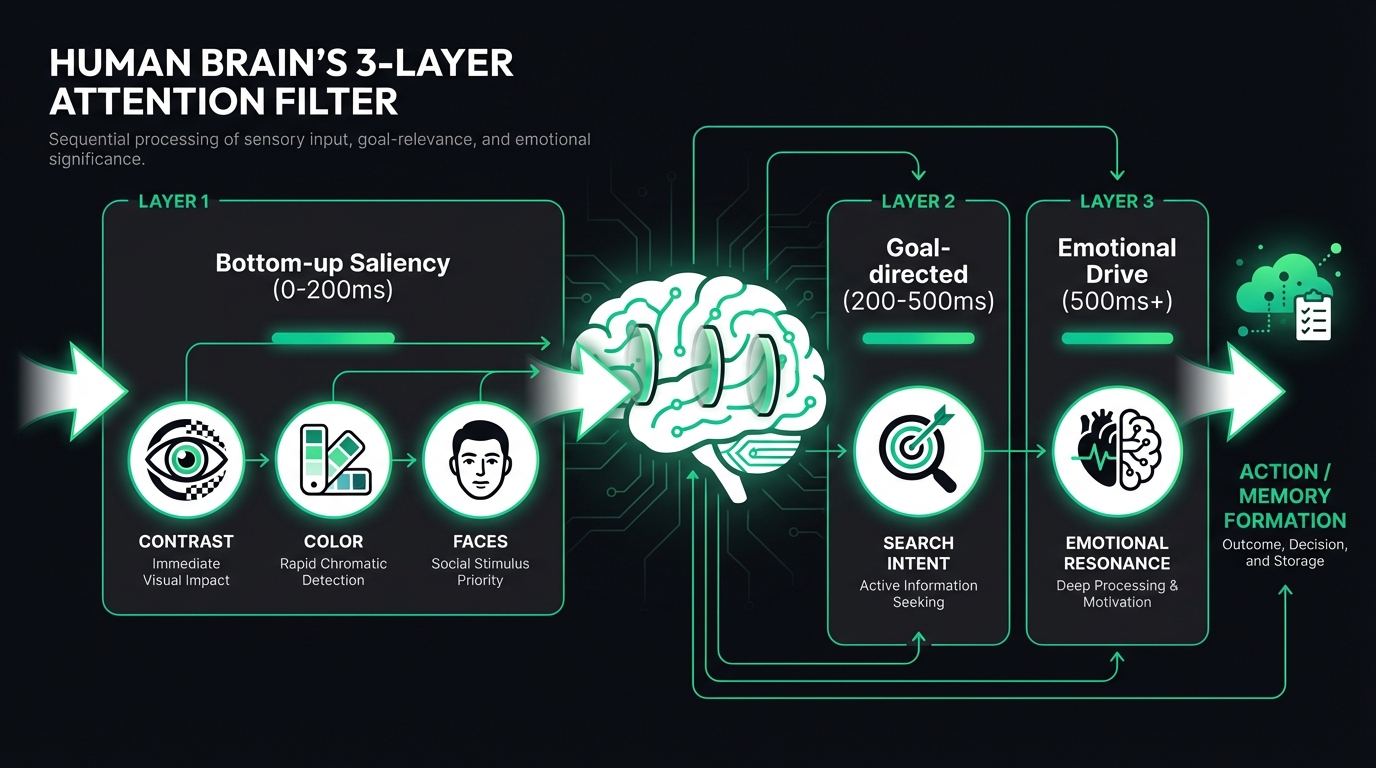

Las tres capas de filtrado de la atención

La asignación de la atención visual sigue un modelo de tres capas:

Primera capa: Saliencia de bajo nivel (0-200ms)

Es completamente automática e inconsciente. Según el artículo clásico de Laurent Itti y Christof Koch en Nature Reviews Neuroscience (2001), "Computational modelling of visual attention", la corteza visual del cerebro (áreas V1-V4) responde automáticamente al alto contraste, colores vibrantes, rostros humanos y movimiento. No es una elección, es instinto.

Datos reales: El análisis de FlowDx de más de 12,000 miniaturas descubrió que las miniaturas que incluyen rostros humanos tienen una puntuación de atención promedio un 47% más alta, mientras que las que usan combinaciones de colores de alto contraste son un 38% superiores.

Segunda capa: Atención orientada a objetivos (200-500ms)

El usuario navega con una intención. Alguien que busca "cómo perder peso" se fijará automáticamente en elementos visuales relacionados con la pérdida de peso. Este filtro es impulsado por la corteza prefrontal; cuanto mayor sea la coincidencia con la intención de búsqueda, mayor será la tasa de clics (CTR).

Tercera capa: Impulsada por las emociones (500ms+)

Joseph LeDoux demostró en The Emotional Brain (Simon & Schuster, 1996) que la amígdala puede responder a estímulos emocionales en unos 170 milisegundos, más rápido de lo que puedes "ver" conscientemente la imagen. El estudio de Adolphs et al. en Journal of Cognitive Neuroscience (2005) encontró además que esta evaluación emocional rápida afecta directamente la asignación de la atención. El contenido que genera curiosidad, urgencia o empatía pasa más fácilmente por este filtro.

Las cinco "zonas muertas" de atención más comunes

Tras analizar miles de piezas de contenido con bajo CTR, resumimos los cinco problemas más frecuentes:

| Problema | Frecuencia | Impacto |

|---|---|---|

| Contraste insuficiente entre texto y fondo | 67% | El título es ilegible en la miniatura |

| Falta de foco visual | 54% | Los ojos no saben dónde mirar |

| Sobrecarga de información | 43% | Demasiados elementos compitiendo por la atención |

| Rostros ocultos o demasiado pequeños | 38% | Se pierde el ancla de atención más fuerte |

| El color se mezcla con el fondo de la plataforma | 31% | El contenido "desaparece" en el feed |

Cómo diagnosticar tu contenido con FlowDx

FlowDx utiliza un motor de IA de tres capas para simular la reacción del cerebro a tu contenido:

- Motor de mapas de calor de atención — Basado en el modelo DeepGaze IIE, predice dónde mirarán primero los ojos del usuario.

- Análisis de activación cognitiva — Evalúa la intensidad del estímulo en diferentes áreas del cerebro (visual, emocional, memoria, decisión).

- Motor de diagnóstico de IA — Análisis profundo con el modelo visual Gemini, proporcionando sugerencias de modificación específicas.

Cada diagnóstico genera una puntuación cognitiva de cinco dimensiones (atención, foco visual, impacto emocional, impulso a la acción, fuerza de memoria) y señala áreas problemáticas específicas y direcciones de mejora.

Diferencias en la competencia por la atención según la plataforma

La intensidad de la competencia por la atención varía según la plataforma. Entender estas diferencias es crucial para optimizar el contenido:

| Plataforma | Tiempo de fijación | Densidad de competencia | Anclas de atención clave |

|---|---|---|---|

| Inicio de YouTube | 0.5-1.2s | 4-8 miniaturas | Rostros + Texto de alto contraste |

| Feed de Instagram | 0.15-0.3s | 2-4 elementos | Saturación de color + Composición |

| Resultados de Amazon | 0.2-0.4s | 6-10 elementos | Claridad del producto + Fondo blanco |

| Feed de TikTok | 1-3s (video) | 1 pantalla completa | Primeros 3 segundos + Elementos dinámicos |

| Instagram (Post) | 0.3-0.8s | 1-3 imágenes | Estética + Consistencia de marca |

Nota: Los patrones de competencia en TikTok e Instagram son fundamentalmente diferentes: son inmersivos a pantalla completa, la competencia ocurre en "si seguir viendo" en lugar de "si hacer clic".

De la teoría a la práctica: 3 pasos para aumentar la atención en tu contenido

Basándonos en los principios científicos anteriores, este es el proceso de optimización que sugerimos:

- Diagnosticar el estado actual — Sube tu contenido a FlowDx, obtén el mapa de calor y la puntuación de cinco dimensiones para identificar problemas específicos.

- Modificar según la referencia — Ajusta según las sugerencias del informe (agrandar rostros, aumentar contraste, simplificar diseño, etc.).

- Validar la comparación — Diagnostica de nuevo tras los cambios, compara la evolución de las puntuaciones y confirma que la dirección de la mejora es correcta.

La mayoría de los problemas de atención se concentran en 2 o 3 puntos clave. Corregirlos suele generar un aumento del 50-200% en el CTR.

Preguntas frecuentes (FAQ)

¿Cuál es la diferencia entre la ciencia de la atención y las pruebas A/B?

Las pruebas A/B te dicen "qué versión es mejor", pero no te dicen "por qué". La ciencia de la atención, al simular el procesamiento visual del cerebro, puede predecir antes de publicar dónde mirará el usuario, qué ignorará y ofrecer direcciones de mejora específicas. Ambos funcionan mejor en conjunto: primero optimiza con análisis de atención y luego valida con pruebas A/B.

¿Son precisos los mapas de calor de atención generados por IA?

El modelo DeepGaze IIE utilizado por FlowDx tiene una precisión superior al 87% (métrica AUC) en el MIT Saliency Benchmark, siendo uno de los modelos de predicción de atención más precisos disponibles actualmente. Este modelo se basa en redes neuronales profundas DenseNet y ResNeXt, entrenadas con más de un millón de datos reales de seguimiento ocular humano.

¿El análisis de atención es aplicable a todo tipo de contenido?

El análisis de atención es más efectivo para imágenes estáticas (miniaturas, portadas, carteles, materiales publicitarios, fotos de producto). Para contenido de video, FlowDx permite el análisis fotograma a fotograma, ayudándote a encontrar los momentos de menor atención. El contenido puramente textual (como títulos de artículos) no está dentro del alcance actual del análisis.

Comienza el diagnóstico

Sube tu miniatura, portada o material publicitario a FlowDx y obtén un informe completo de diagnóstico de atención en menos de 30 segundos. Los usuarios gratuitos pueden realizar una prueba.

Referencias

- Wilson, T. D. (2002). Strangers to Ourselves: Discovering the Adaptive Unconscious. Harvard University Press.

- Itti, L., & Koch, C. (2001). Computational modelling of visual attention. Nature Reviews Neuroscience, 2(3), 194-203.

- LeDoux, J. E. (1996). The Emotional Brain. Simon & Schuster.

- Adolphs, R. et al. (2005). A mechanism for impaired fear recognition after amygdala damage. Journal of Cognitive Neuroscience, 17(7), 1039-1050.

- Linardos, A. et al. (2021). DeepGaze IIE: Calibrated prediction in and out-of-domain for state-of-the-art saliency modeling. ICLR 2021.

- Borji, A., & Itti, L. (2013). State-of-the-art in visual attention modeling. IEEE TPAMI, 35(1), 185-207.