Vous avez soigneusement conçu une miniature, rédigé un titre que vous pensiez accrocheur, et après publication — 200 vues. Le compte d'à côté publie n'importe quoi et obtient 200 000 vues.

Ce n'est pas de la chance, ni une injustice de l'algorithme. C'est la science de l'attention.

Votre cerveau est une machine de filtrage impitoyable

Selon les recherches de Timothy Wilson dans Strangers to Ourselves (Harvard University Press, 2002), le cerveau humain reçoit environ 11 millions de bits d'informations sensorielles par seconde, mais la bande passante de l'attention consciente n'est que de 50 bits/seconde. Cela signifie que 99,9995 % des informations sont rejetées avant même que vous n'en ayez conscience.

Lorsque les utilisateurs naviguent sur YouTube, Xiaohongshu ou Taobao, votre contenu rivalise avec des dizaines d'autres pour ces précieux 50 bits d'attention. Une étude d'eye-tracking du MIT Media Lab en 2019 a révélé que le temps de fixation moyen d'un utilisateur sur un contenu unique dans un flux mobile n'est que de 0,3 à 0,5 seconde.

Les trois niveaux de filtrage de l'attention

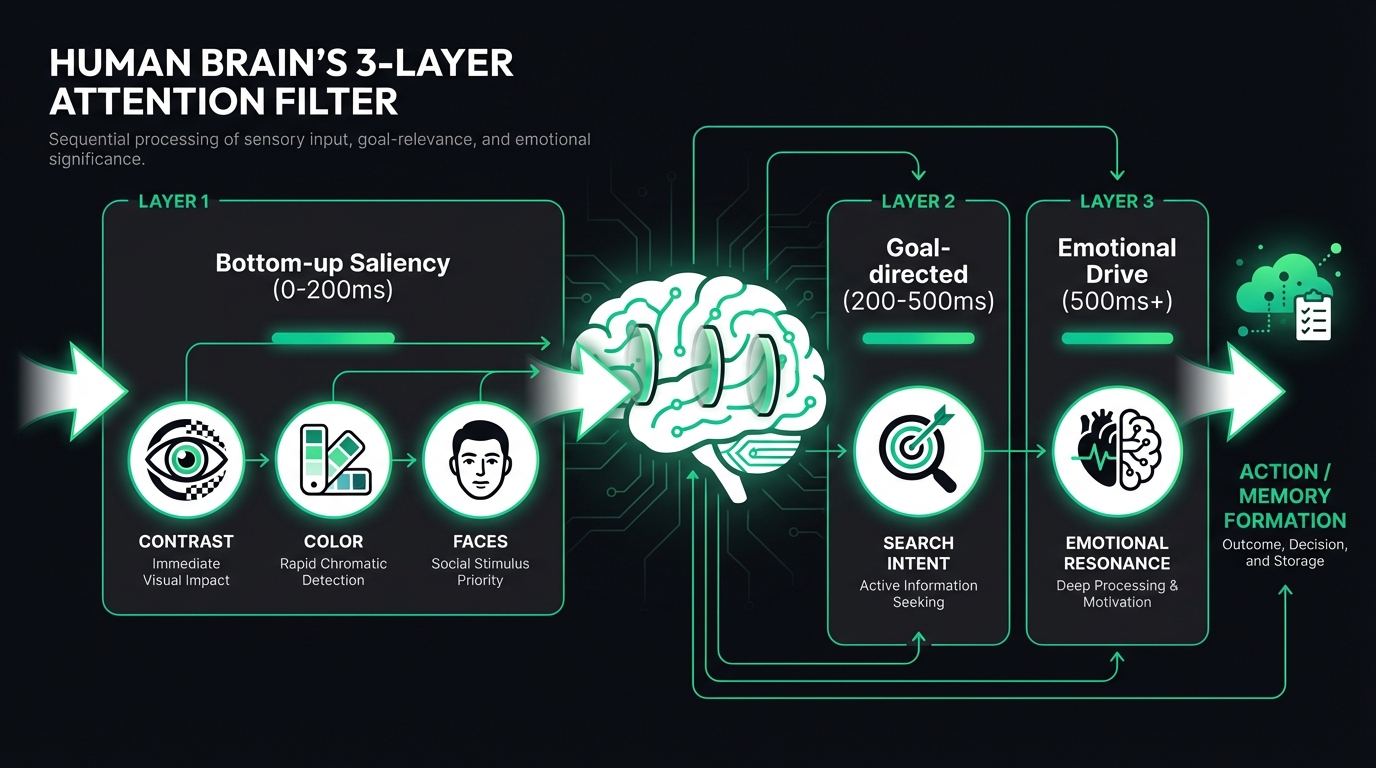

L'allocation de l'attention visuelle suit un modèle à trois niveaux :

Niveau 1 : Saillance ascendante (0-200ms)

C'est un processus totalement automatique et inconscient. Selon l'article classique de Laurent Itti et Christof Koch publié dans Nature Reviews Neuroscience (2001), « Computational modelling of visual attention », le cortex visuel du cerveau (zones V1-V4) réagit automatiquement aux contrastes élevés, aux couleurs vives, aux visages humains et au mouvement. Ce n'est pas un choix, c'est un instinct.

Données réelles : L'analyse de FlowDx sur plus de 12 000 miniatures a révélé que les miniatures contenant des visages obtiennent un score d'attention moyen supérieur de 47 %, tandis que celles utilisant des combinaisons de couleurs à haut contraste sont supérieures de 38 %.

Niveau 2 : Attention orientée vers un but (200-500ms)

L'utilisateur navigue avec une intention. Quelqu'un qui cherche « comment perdre du poids » se concentrera automatiquement sur les éléments visuels liés à la perte de poids. Ce filtre est piloté par le cortex préfrontal : plus la correspondance avec l'intention de recherche est élevée, plus le taux de clic est important.

Niveau 3 : Impulsion émotionnelle (500ms+)

Joseph LeDoux a démontré dans The Emotional Brain (Simon & Schuster, 1996) que l'amygdale peut réagir à des stimuli émotionnels en environ 170 millisecondes — plus vite que vous ne pouvez « voir » consciemment l'image. Les recherches d'Adolphs et al. dans le Journal of Cognitive Neuroscience (2005) ont ensuite révélé que cette évaluation émotionnelle rapide influence directement l'allocation de l'attention. Les contenus qui suscitent la curiosité, l'urgence ou la résonance passent plus facilement ce filtre.

Les cinq « zones mortes » d'attention les plus courantes

Après avoir analysé des milliers de contenus à faible taux de clic, nous avons résumé les cinq problèmes les plus fréquents :

| Problème | Fréquence | Impact |

|---|---|---|

| Contraste texte/fond insuffisant | 67% | Le titre est illisible dans la miniature |

| Absence de point focal visuel | 54% | L'œil ne sait pas où regarder |

| Surcharge d'informations | 43% | Trop d'éléments rivalisent pour l'attention |

| Visages masqués ou trop petits | 38% | Perte du point d'ancrage d'attention le plus fort |

| Couleurs fondues dans le fond de la plateforme | 31% | Le contenu « disparaît » dans le flux |

Comment diagnostiquer votre contenu avec FlowDx

FlowDx utilise un moteur d'IA à trois couches pour simuler la réaction du cerveau à votre contenu :

- Moteur de carte de chaleur d'attention — Basé sur le modèle DeepGaze IIE, il prédit où les yeux de l'utilisateur se poseront en premier.

- Analyse d'activation cognitive — Évalue l'intensité de la stimulation sur différentes zones du cerveau (visuelle, émotionnelle, mémorielle, décisionnelle).

- Moteur de diagnostic IA — Analyse approfondie par le modèle visuel Gemini pour fournir des suggestions de modification concrètes.

Chaque diagnostic génère un score cognitif en cinq dimensions (attention, focus visuel, impact émotionnel, moteur d'action, force mémorielle), tout en signalant les zones problématiques spécifiques et les pistes d'amélioration.

Différences de compétition d'attention selon les plateformes

L'intensité de la compétition pour l'attention varie selon la plateforme. Comprendre ces nuances est crucial pour optimiser votre contenu :

| Plateforme | Temps de fixation | Densité de compétition | Ancres d'attention clés |

|---|---|---|---|

| Accueil YouTube | 0,5-1,2s | 4-8 vignettes côte à côte | Visages + Texte contrasté |

| Flux Xiaohongshu | 0,15-0,3s | 2-4 vignettes côte à côte | Saturation des couleurs + Mise en page |

| Résultats Taobao | 0,2-0,4s | 6-10 vignettes côte à côte | Clarté du produit + Fond blanc |

| Flux Douyin | 1-3s (vidéo) | 1 plein écran | 3 premières secondes + Éléments dynamiques |

| 0,3-0,8s | 1-3 publications | Qualité esthétique + Cohérence de marque |

Note : Le mode de compétition sur Douyin et Instagram est fondamentalement différent des autres plateformes — ils sont immersifs en plein écran, la compétition porte sur le fait de « continuer à regarder » plutôt que de « cliquer pour entrer ».

De la théorie à la pratique : 3 étapes pour booster l'attention de votre contenu

Sur la base de ces principes scientifiques, voici le processus d'optimisation que nous recommandons :

- Diagnostiquer l'état actuel — Téléchargez votre contenu sur FlowDx pour obtenir une carte de chaleur et un score en cinq dimensions afin d'identifier les problèmes spécifiques.

- Modifier selon les recommandations — Ajustez votre visuel en fonction des conseils du rapport (agrandir les visages, augmenter le contraste, simplifier la mise en page, etc.).

- Valider par comparaison — Diagnostiquez à nouveau après modification pour comparer l'évolution des scores et confirmer que l'amélioration va dans la bonne direction.

La plupart des problèmes d'attention se concentrent sur 2 ou 3 points clés. Corriger ces points centraux permet généralement d'obtenir une augmentation du taux de clic de 50 à 200 %.

Questions Fréquentes (FAQ)

Quelle est la différence entre la science de l'attention et l'A/B testing ?

L'A/B testing vous dit « quelle version est la meilleure », mais ne vous dit pas « pourquoi ». La science de l'attention, en simulant le traitement visuel du cerveau, peut prédire avant la publication où l'utilisateur regardera, ce qu'il ignorera, et donner des directions de modification précises. Les deux fonctionnent mieux ensemble : optimisez d'abord avec l'analyse d'attention, puis validez avec l'A/B testing.

Les cartes de chaleur générées par l'IA sont-elles fiables ?

Le modèle DeepGaze IIE utilisé par FlowDx affiche une précision de prédiction supérieure à 87 % (indice AUC) sur le MIT Saliency Benchmark, ce qui en fait l'un des modèles de prédiction d'attention les plus précis disponibles publiquement. Ce modèle repose sur des réseaux de neurones profonds DenseNet et ResNeXt, entraînés sur plus d'un million de données réelles d'eye-tracking humain.

L'analyse d'attention s'applique-t-elle à tous les types de contenu ?

L'analyse d'attention est particulièrement efficace pour les images statiques (miniatures, couvertures, affiches, créations publicitaires, photos de produits). Pour le contenu vidéo, FlowDx permet une analyse image par image pour identifier les moments où l'attention faiblit. Le contenu purement textuel (comme les titres d'articles seuls) n'est pas couvert par l'analyse actuelle.

Commencer le diagnostic

Téléchargez votre miniature, image de couverture ou création publicitaire sur FlowDx et obtenez un rapport complet de diagnostic d'attention en moins de 30 secondes. Un essai gratuit est disponible pour les nouveaux utilisateurs.

Références

- Wilson, T. D. (2002). Strangers to Ourselves: Discovering the Adaptive Unconscious. Harvard University Press.

- Itti, L., & Koch, C. (2001). Computational modelling of visual attention. Nature Reviews Neuroscience, 2(3), 194-203.

- LeDoux, J. E. (1996). The Emotional Brain. Simon & Schuster.

- Adolphs, R. et al. (2005). A mechanism for impaired fear recognition after amygdala damage. Journal of Cognitive Neuroscience, 17(7), 1039-1050.

- Linardos, A. et al. (2021). DeepGaze IIE: Calibrated prediction in and out-of-domain for state-of-the-art saliency modeling. ICLR 2021.

- Borji, A., & Itti, L. (2013). State-of-the-art in visual attention modeling. IEEE TPAMI, 35(1), 185-207.