Hai creato con cura una miniatura, scritto un titolo che ritenevi accattivante, e dopo la pubblicazione... 200 visualizzazioni. L'account accanto pubblica qualcosa a caso e ottiene 200.000 visualizzazioni.

Non è fortuna, né un algoritmo ingiusto. È la scienza dell'attenzione.

Il tuo cervello è una spietata macchina di filtraggio

Secondo la ricerca di Timothy Wilson in Strangers to Ourselves (Harvard University Press, 2002), il cervello umano riceve circa 11 milioni di bit di informazioni sensoriali al secondo, ma la larghezza di banda dell'attenzione cosciente è di soli 50 bit/secondo. Ciò significa che il 99,9995% delle informazioni viene scartato prima ancora che tu te ne renda conto.

Quando gli utenti navigano su YouTube, Instagram o Amazon, il tuo contenuto compete con decine di altri per quei 50 bit di attenzione. Uno studio di eye-tracking del MIT Media Lab del 2019 ha rilevato che il tempo medio di fissazione di un utente su un singolo contenuto nei feed mobile è di soli 0,3-0,5 secondi.

I tre livelli di filtraggio dell'attenzione

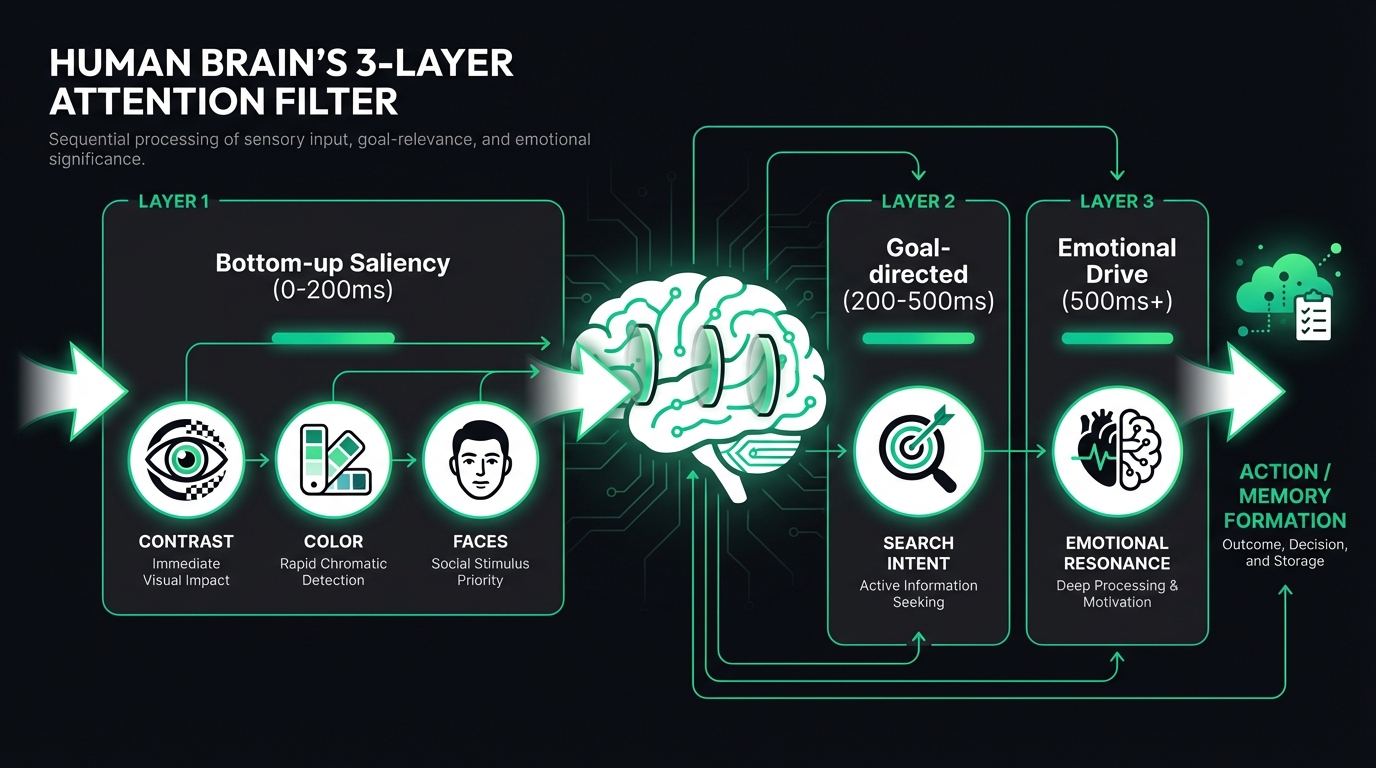

L'allocazione dell'attenzione visiva segue un modello a tre livelli:

Primo livello: Salienza di base (0-200ms)

È completamente automatico e inconscio. Secondo il classico articolo di Laurent Itti e Christof Koch pubblicato su Nature Reviews Neuroscience (2001), "Computational modelling of visual attention", la corteccia visiva del cervello (aree V1-V4) reagisce automaticamente a contrasti elevati, colori vivaci, volti umani e movimento. Non è una scelta, è istinto.

Dati reali: l'analisi di FlowDx su oltre 12.000 miniature ha rilevato che le miniature contenenti volti umani hanno un punteggio di attenzione medio superiore del 47%, mentre quelle che utilizzano combinazioni di colori ad alto contrasto sono superiori del 38%.

Secondo livello: Attenzione orientata all'obiettivo (200-500ms)

Gli utenti navigano con un'intenzione. Chi cerca "come dimagrire" presterà automaticamente attenzione agli elementi visivi correlati alla perdita di peso. Questo filtro è guidato dalla corteccia prefrontale: maggiore è la corrispondenza con l'intento di ricerca, maggiore è il click-through rate (CTR).

Terzo livello: Spinta emotiva (500ms+)

Joseph LeDoux in The Emotional Brain (Simon & Schuster, 1996) ha dimostrato che l'amigdala può reagire agli stimoli emotivi in circa 170 millisecondi, più velocemente di quanto tu possa "vedere" consapevolmente l'immagine. La ricerca di Adolphs et al. nel Journal of Cognitive Neuroscience (2005) ha ulteriormente scoperto che questa rapida valutazione emotiva influenza direttamente l'allocazione dell'attenzione. I contenuti che generano curiosità, urgenza o empatia superano più facilmente questo filtro.

Le cinque "zone morte" dell'attenzione più comuni

Abbiamo analizzato migliaia di contenuti a basso CTR e riassunto i cinque problemi più comuni:

| Problema | Frequenza | Impatto |

|---|---|---|

| Contrasto insufficiente tra testo e sfondo | 67% | Il titolo è illeggibile nella miniatura |

| Mancanza di un punto focale visivo | 54% | L'occhio non sa dove guardare |

| Sovraccarico di informazioni | 43% | Troppi elementi competono per l'attenzione |

| Volti coperti o troppo piccoli | 38% | Perdita del più forte punto di ancoraggio dell'attenzione |

| Colori che si fondono con lo sfondo della piattaforma | 31% | Il contenuto "scompare" nel feed |

Come diagnosticare i tuoi contenuti con FlowDx

FlowDx utilizza un motore AI a tre livelli per simulare la reazione del cervello ai tuoi contenuti:

- Motore di mappe di calore dell'attenzione — Basato sul modello DeepGaze IIE, prevede dove guarderanno per primi gli occhi dell'utente

- Analisi dell'attivazione cognitiva — Valuta l'intensità della stimolazione su diverse aree del cervello (visiva, emotiva, memoria, decisionale)

- Motore di diagnosi AI — Analisi approfondita con il modello visivo Gemini, fornendo suggerimenti specifici per le modifiche

Ogni diagnosi genera un punteggio cognitivo a cinque dimensioni (Attenzione, Focus Visivo, Impatto Emotivo, Spinta all'Azione, Intensità della Memoria), contrassegnando aree problematiche specifiche e direzioni per il miglioramento.

Differenze nella competizione per l'attenzione tra le varie piattaforme

L'intensità della competizione per l'attenzione varia a seconda della piattaforma. Comprendere queste differenze è fondamentale per ottimizzare i contenuti:

| Piattaforma | Tempo di fissazione | Densità di competizione | Punti di ancoraggio chiave |

|---|---|---|---|

| Homepage di YouTube | 0,5-1,2s | 4-8 affiancati | Volti + Testo ad alto contrasto |

| Feed di Instagram | 0,15-0,3s | 2-4 affiancati | Saturazione del colore + Layout |

| Risultati di ricerca Amazon | 0,2-0,4s | 6-10 affiancati | Chiarezza del prodotto + Sfondo bianco |

| Feed di TikTok | 1-3s (video) | 1 a schermo intero | Primi 3 secondi + Elementi dinamici |

| Instagram (Profilo) | 0,3-0,8s | 1-3 immagini | Estetica + Coerenza del brand |

Nota: i modelli di competizione per l'attenzione di TikTok e Instagram sono fondamentalmente diversi dagli altri: sono immersivi a schermo intero, la competizione riguarda il "continuare a guardare" piuttosto che il "cliccare per entrare".

Dalla teoria alla pratica: 3 passaggi per aumentare l'attenzione sui tuoi contenuti

Basandoci sui principi scientifici sopra esposti, ecco il processo di ottimizzazione suggerito:

- Diagnostica lo stato attuale — Carica il tuo contenuto su FlowDx per ottenere la mappa di calore e il punteggio a cinque dimensioni, individuando i problemi specifici

- Apporta modifiche mirate — In base ai suggerimenti del report, regola gli elementi (ingrandire i volti, aumentare il contrasto, semplificare il layout, ecc.)

- Verifica e confronta — Diagnostica di nuovo dopo le modifiche per confrontare il cambiamento del punteggio e confermare la direzione del miglioramento

La maggior parte dei problemi di attenzione nei contenuti si concentra su 2-3 punti chiave. Risolvere questi problemi principali porta solitamente a un aumento del CTR del 50-200%.

Domande frequenti (FAQ)

Qual è la differenza tra la scienza dell'attenzione e l'A/B testing?

L'A/B testing ti dice "quale versione è migliore", ma non ti dice "perché". La scienza dell'attenzione, simulando il processo di elaborazione visiva del cervello, può prevedere dove gli utenti guarderanno o cosa ignoreranno prima della pubblicazione, fornendo indicazioni specifiche per le modifiche. I due metodi funzionano meglio se usati insieme: ottimizza prima con l'analisi dell'attenzione, poi verifica con l'A/B testing.

Le mappe di calore generate dall'AI sono accurate?

Il modello DeepGaze IIE utilizzato da FlowDx ha un'accuratezza di previsione superiore all'87% (metrica AUC) sul MIT Saliency Benchmark, rendendolo uno dei modelli di previsione dell'attenzione più accurati attualmente disponibili. Il modello si basa sulle reti neurali profonde DenseNet e ResNeXt, addestrate su oltre 1 milione di dati reali di eye-tracking umano.

L'analisi dell'attenzione è applicabile a tutti i tipi di contenuto?

L'analisi dell'attenzione è estremamente efficace per le immagini statiche (miniature, copertine, poster, annunci pubblicitari, foto di prodotti). Per i contenuti video, FlowDx supporta l'analisi fotogramma per fotogramma per aiutarti a trovare i momenti in cui l'attenzione è più debole. I contenuti di solo testo (come i titoli degli articoli) non rientrano nell'attuale ambito di analisi.

Inizia la diagnosi

Carica la tua miniatura, copertina o materiale pubblicitario su FlowDx e ottieni un report diagnostico completo dell'attenzione in meno di 30 secondi. Gli utenti gratuiti possono effettuare 1 prova.

Riferimenti

- Wilson, T. D. (2002). Strangers to Ourselves: Discovering the Adaptive Unconscious. Harvard University Press.

- Itti, L., & Koch, C. (2001). Computational modelling of visual attention. Nature Reviews Neuroscience, 2(3), 194-203.

- LeDoux, J. E. (1996). The Emotional Brain. Simon & Schuster.

- Adolphs, R. et al. (2005). A mechanism for impaired fear recognition after amygdala damage. Journal of Cognitive Neuroscience, 17(7), 1039-1050.

- Linardos, A. et al. (2021). DeepGaze IIE: Calibrated prediction in and out-of-domain for state-of-the-art saliency modeling. ICLR 2021.

- Borji, A., & Itti, L. (2013). State-of-the-art in visual attention modeling. IEEE TPAMI, 35(1), 185-207.