FlowDx のアテンションヒートマップは、DeepGaze IIE モデルに基づいています。このモデルは、ドイツのテュービンゲン大学 Bethge Lab 計算神経科学研究所の Linardos らによる ICLR 2021 の論文『DeepGaze IIE: Calibrated prediction in and out-of-domain for state-of-the-art saliency modeling』で提案されました。MIT/Tilburg Saliency Benchmark において、DeepGaze IIE は複数の指標で1位を獲得しており、その予測結果と実際の人間の視線データとの相関性は 0.87 を超えています。

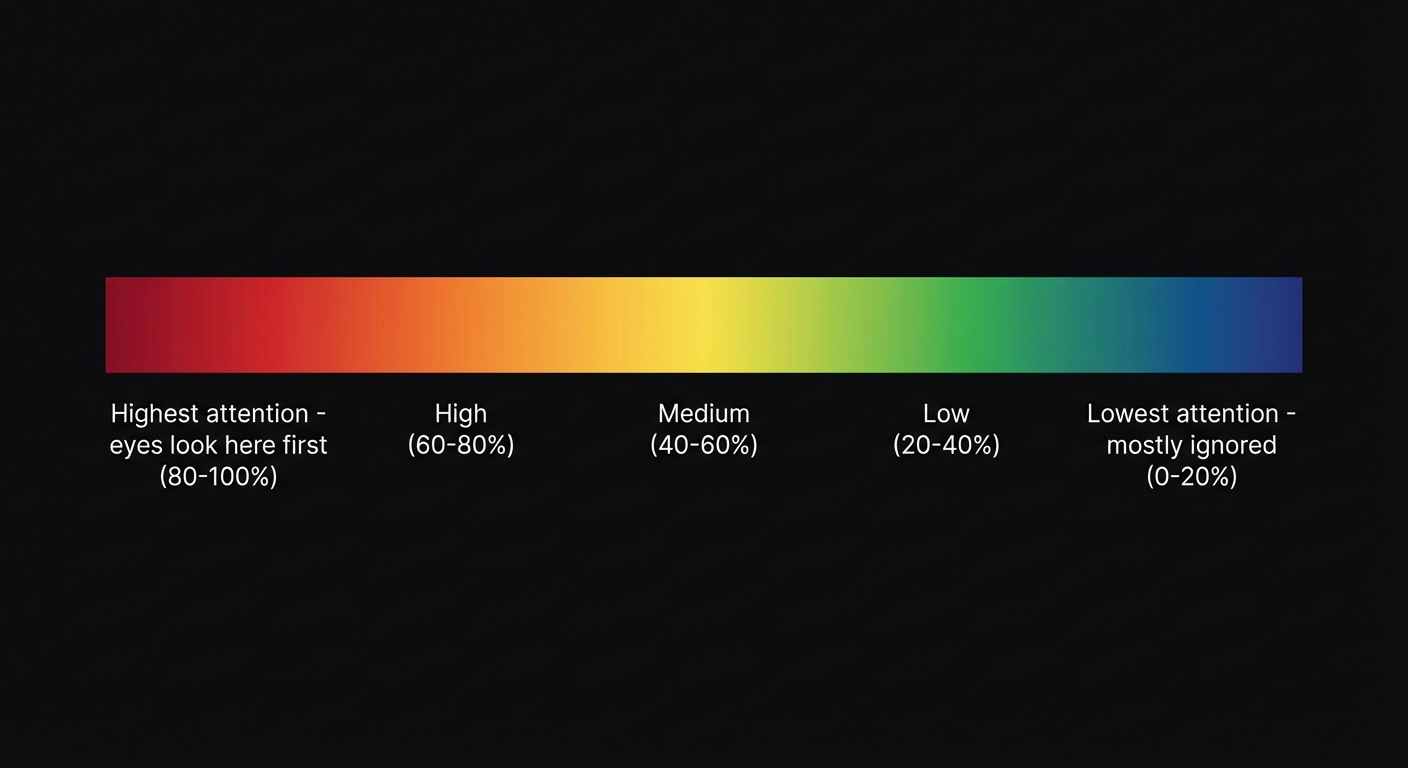

ヒートマップの色は何を意味するのか?

| 色 | 意味 | アテンションの割合 |

|---|---|---|

| 赤 | 最高のアテンションエリア — ユーザーが最初にここを見る | 上位 10% |

| オレンジ | 高いアテンション — 視線が素早くここに移動する | 10-30% |

| 緑 | 中程度のアテンション — 閲覧の過程で注目される | 30-60% |

| 青 | 低いアテンション — ほとんどのユーザーが無視する | 60-90% |

| 暗い色/無色 | アテンションの盲点 — ほとんど誰も見ない | 下位 10% |

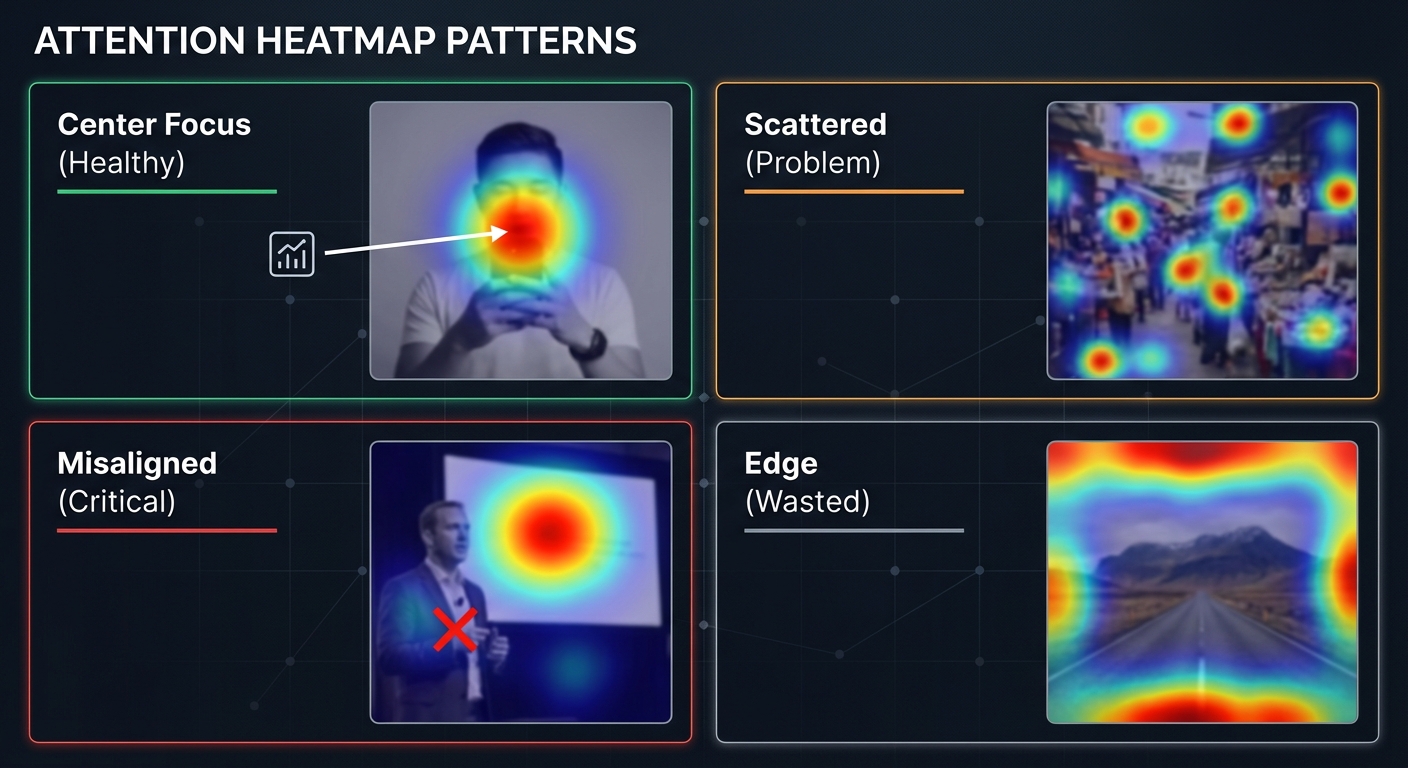

一般的なヒートマップのパターン

パターン1:中心フォーカス型(健全)

赤いエリアがコンテンツの核となる情報(顔、タイトル、CTAボタン)に集中しています。これは視覚的な階層が明確であり、ユーザーが伝えたい情報を素早く理解できることを意味します。

パターン2:分散型(問題あり)

赤いエリアが複数の場所に分散しており、明確なメインフォーカスがありません。これは画面内の要素が多すぎて、注意が散漫になっていることを示しています。解決策:要素の数を減らし、明確な視覚的主体を確立する。

パターン3:ズレ型(深刻な問題)

赤いエリアがユーザーに見てほしくない場所(背景の無関係な要素など)に集中しており、核となる情報(タイトル、製品)が青や緑のエリアになっています。これは CTR キラーです。

パターン4:エッジ型(無駄)

注意が画像の端に集中しています。これは通常、主体が小さすぎたり、余白が多すぎたりする場合に起こります。脳はエッジの高コントラストな領域(画像の境界線と背景の境目など)に引き寄せられてしまいます。

視覚パス:ユーザーの"閲覧ルート"

ヒートマップに加えて、FlowDx は視覚パスも生成します。これは、ユーザーの目がどこから始まり、どのような順序で画面をスキャンするかを予測するものです。理想的な視覚パスは以下の通りです:

- 最強のアテンションアンカーから始まる(通常は顔や最大の文字)

- 補助的な情報(サブタイトル、製品画像)へ移動する

- 最終的に CTA(コールトゥアクション)に到達する

パスが重要な情報をスキップしていたり、無関係なエリアを彷徨っていたりする場合、視覚的な誘導に問題があることを示しています。

5つの認知的評価指標の詳細

FlowDx は総合スコアだけでなく、5つの認知的側面からコンテンツを評価します:

- アテンション — コンテンツが 0.3 秒以内に目を引くかどうか

- 視覚フォーカス — 明確な視覚的階層と誘導パスがあるかどうか

- 感情的インパクト — 感情的な反応(好奇心、興奮、共感)を引き出せるかどうか

- アクション駆動 — 明確なコールトゥアクション(CTA)があるかどうか

- 記憶の強さ — ユーザーが見終わった後にコンテンツを覚えているかどうか

各指標は 0-100 点です。70点以上は優秀、50-70点は最適化が必要、50点以下は深刻な問題があることを示します。

ヒートマップ診断を始める

診断レポートに基づいてコンテンツを最適化する方法

FlowDx の診断レポートを受け取ったら、以下の優先順位で問題に対処してください:

優先順位1:「ズレ型」問題の修正(赤い診断項目)

注意が間違った場所(背景要素、無関係な詳細)に集中している場合、これは最も深刻な問題です。解決策は通常、ノイズとなる要素の視覚的ウェイトを下げ(ぼかし、彩度を下げる)、同時に核となる情報の顕著性を高める(拡大、コントラストの追加、枠線の追加)ことです。

優先順位2:明確な視覚パスの確立(オレンジの診断項目)

ヒートマップで注意が分散している場合は、明確な視覚的階層を構築する必要があります。サイズのコントラスト(最も重要な要素を最大にする)、色のコントラスト(核となる情報に高彩度色を使用する)、空間的な誘導(矢印、ライン、人物の視線の方向)を使用して、ユーザーの視線があらかじめ設定したパスに沿って移動するように誘導します。

優先順位3:全体的な認知的評価の向上(黄色の提案項目)

5つの評価指標のうち 60 点未満の項目に重点を置く必要があります。一般的な改善方法:

| 指標が低い | 考えられる原因 | 改善の方向性 |

|---|---|---|

| アテンション < 60 | 画面が地味で顕著性に欠ける | コントラストを上げる、顔を入れる、高彩度色を使用する |

| 視覚フォーカス < 60 | 要素が多くて煩雑 | 要素の数を減らす、主従の階層を作る |

| 感情的インパクト < 60 | コンテンツに感情的なトリガーが欠けている | 感情豊かな表情を使う、ギャップを作る、ストーリーを伝える |

| アクション駆動 < 60 | CTA や行動の示唆が欠けている | 矢印、ボタン、「今すぐ」「期間限定」などのトリガーワードを追加する |

| 記憶の強さ < 60 | コンテンツが平凡で独自性に欠ける | ブランドシンボルを確立する、独特の配色を使用する、視覚的な記憶ポイントを作る |

ヒートマップ分析の限界

アテンションヒートマップは強力なツールですが、限界もあります。これらの境界を正直に理解することは、ツールをより良く活用するのに役立ちます:

- 予測されるのは「平均的なユーザー」です — ヒートマップは集団の平均的な注視分布を反映しており、個々のユーザーの視線パスは異なる場合があります。

- クリック率と直結するわけではありません — 高いアテンションが必ずしも高いクリックに繋がるとは限りません。ユーザーは注目しても、クリックしないことを選択する場合があります(例:コンテンツが面白そうに見えない)。

- 画像の品質に依存します — 低解像度や過度に圧縮された画像は、予測の精度に影響を与える可能性があります。

- 文化的な違い — 異なる文化的背景を持つユーザーは、色、顔、シンボルに対する注意の配分が異なる場合があります。

FlowDx の5つの認知的評価指標は、まさに純粋なヒートマップ分析の不足を補うためのものです。アテンション、感情、記憶などの複数の側面を総合的に考慮し、より包括的なコンテンツ診断を提供します。

よくある質問(FAQ)

ヒートマップの赤いエリアが一番良いのですか?

必ずしもそうではありません。赤はユーザーが最初に注視するエリアを示しますが、重要なのは赤いエリアが最も伝えたい情報の上にあるかどうかです。もし赤が無関係な背景にあるなら、それはむしろ問題があることを示しています。理想的な状態は、赤が核となる情報(製品、顔、タイトル)をカバーし、青が二次的なエリアをカバーしている状態です。

視覚パスの注視点はいくつくらいが良いですか?

サムネイルやカバー画像の場合、3〜5個の注視点が最適な範囲です。少なすぎる(1〜2個)とコンテンツの情報量が不足していることを示し、多すぎる(6個以上)と注意が分散しすぎていることを示します。理想的なパスは、メインフォーカス → 補助情報 → CTA となり、明確なストーリーラインを形成することです。

なぜ私のヒートマップは、他の人が同じ画像を分析した結果と違うのですか?

FlowDx は決定論的モデル(DeepGaze IIE)を使用しているため、同じ画像に対する分析結果は完全に一致します。もし異なる結果が見られる場合は、画像の解像度、クロップ(切り抜き)方法、またはファイルの圧縮率の違いが原因である可能性があります。分析には元の解像度の画像を使用することをお勧めします。

動画のヒートマップと静止画の違いは何ですか?

動画コンテンツでは、注意の分布は時間とともに変化します。FlowDx は動画をフレームごとに分析し、各フレームに独立したヒートマップを作成します。動画は静止画よりも動的な要素(動く物体、切り替わる画面)が注意を強く引きつけるという次元が加わります。動画分析の鍵は、アテンションが最も弱くなるフレームを見つけることです。なぜなら、そこがユーザーが離脱する可能性が最も高い瞬間だからです。

ヒートマップ診断を始める

FlowDx でコンテンツをアップロードし、アテンションヒートマップ、視覚パス、5つの認知的評価指標を取得しましょう。ユーザーの脳内であなたのコンテンツがどのように処理されているかを確認してください。

参考文献

- Linardos, A. et al. (2021). DeepGaze IIE: Calibrated prediction in and out-of-domain for state-of-the-art saliency modeling. ICLR 2021.

- Borji, A., & Itti, L. (2013). State-of-the-art in visual attention modeling. IEEE Transactions on Pattern Analysis and Machine Intelligence, 35(1), 185-207.

- Bylinskii, Z. et al. (2019). What do different evaluation metrics tell us about saliency models? IEEE TPAMI, 41(3), 740-757.