あなたが精魂込めて作ったサムネイル、魅力的なタイトルを付けて投稿したとしても、再生回数はわずか200回。一方で、他の方のアカウントが何気なく投稿した内容は20万回再生されている。

これは運でも、アルゴリズムの不公平でもありません。それは「アテンション・サイエンス(注意力の科学)」によるものです。

あなたの脳は、冷酷なフィルタリング・マシンである

Timothy Wilson氏の著書『Strangers to Ourselves』(Harvard University Press, 2002)の研究によると、人間の脳は毎秒約1,100万ビットの感覚情報を受け取っていますが、意識的な注意力の帯域幅はわずか50ビット/秒しかありません。つまり、情報の99.9995%は、あなたが意識する前に捨てられているのです。

ユーザーが YouTube、Instagram、Amazonなどでブラウジングしているとき、あなたのコンテンツは他の数十のコンテンツと同時に、そのわずか50ビットの注意力を奪い合っています。MITメディアラボの2019年のアイトラッキング研究では、モバイル端末のフィードにおいて、ユーザーが1つのコンテンツを注視する平均時間はわずか0.3〜0.5秒であることが判明しました。

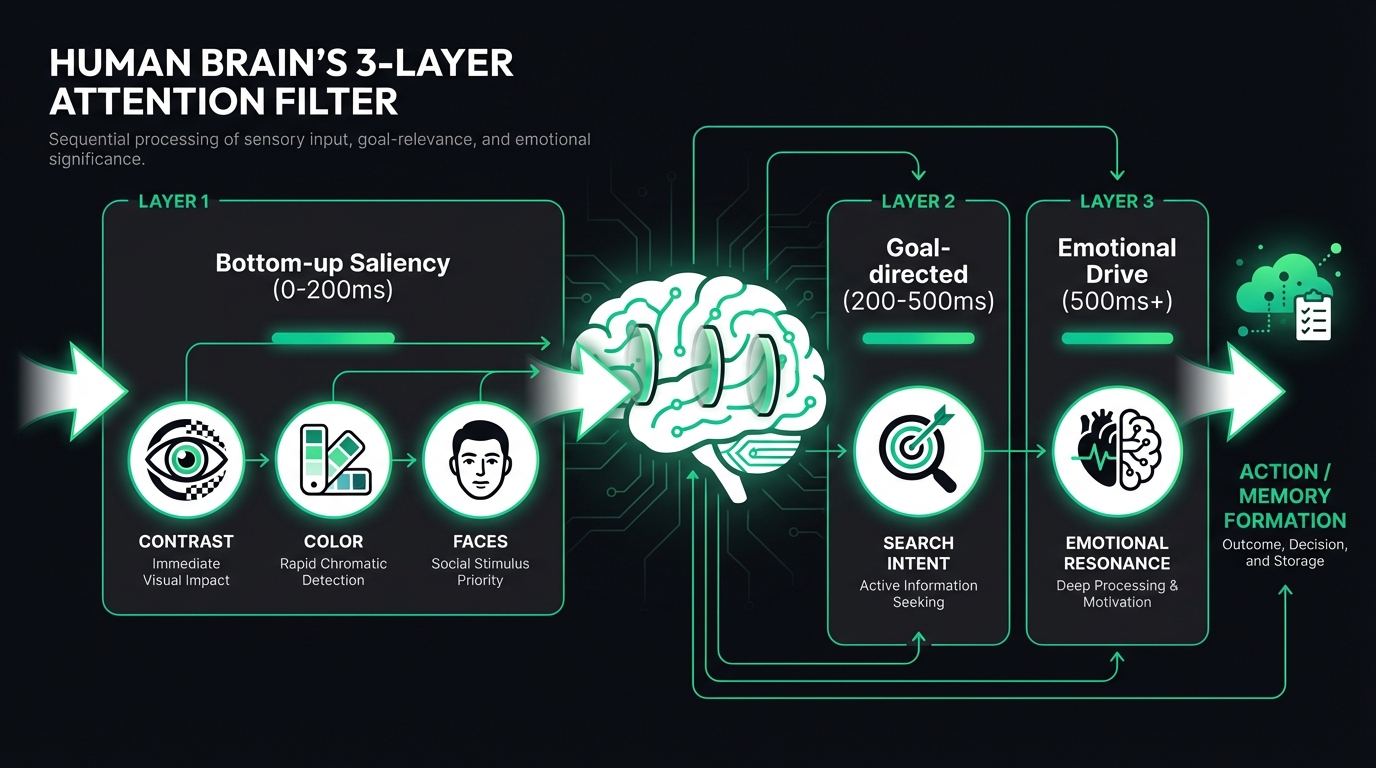

注意力の3層フィルター

視覚的注意力の配分は、以下の3層モデルに従います:

第1層:低次顕著性(0-200ms)

これは完全に自動的で、無意識的なものです。Laurent Itti氏とChristof Koch氏が Nature Reviews Neuroscience (2001) で発表した古典的な論文『Computational modelling of visual attention』によると、脳の視覚皮質(V1-V4領域)は、高コントラスト、鮮やかな色、顔、動きに対して自動的に反応します。これは選択ではなく、本能です。

実際のデータ:FlowDxが12,000枚以上のサムネイルを分析した結果、顔が含まれるサムネイルは平均アテンションスコアが47%高く、高コントラストな色の組み合わせを使用したサムネイルは38%高いことがわかりました。

第2層:目標指向的注意(200-500ms)

ユーザーは目的を持ってブラウジングします。「ダイエット方法」を検索している人は、ダイエットに関連する視覚要素に自動的に注目します。このフィルターは前頭前皮質によって駆動され、検索意図との一致度が高いほど、クリック率は向上します。

第3層:感情駆動(500ms以上)

Joseph LeDoux氏は The Emotional Brain (Simon & Schuster, 1996) の中で、扁桃体が約170ミリ秒以内に感情的な刺激に反応することを証明しました。これは、あなたが意識的に画像を「はっきりと見る」よりも速いスピードです。Adolphs氏らによる Journal of Cognitive Neuroscience (2005) の研究では、この素早い感情評価が注意力の配分に直接影響を与えることがさらに明らかになりました。好奇心、切迫感、共感を生み出すコンテンツは、このフィルターを通過しやすくなります。

最も一般的な5つの注意力の「デッドゾーン」

数千の低クリック率コンテンツを分析した結果、最も一般的な5つの問題をまとめました:

| 問題 | 出現頻度 | 影響 |

|---|---|---|

| テキストと背景のコントラスト不足 | 67% | サムネイル内のタイトルが読めない |

| 視覚的フォーカスの欠如 | 54% | どこを見ればいいのか目が迷う |

| 情報過多 | 43% | 要素が多すぎて注意力が分散する |

| 顔が隠れている、または小さすぎる | 38% | 最も強力なアテンションアンカーを失う |

| 色がプラットフォームの背景に溶け込んでいる | 31% | コンテンツがフィードの中で「消えて」しまう |

FlowDxでコンテンツを診断する方法

FlowDxは、脳の反応をシミュレートするために3層のAIエンジンを使用しています:

- アテンションヒートマップエンジン — DeepGaze IIEモデルに基づき、ユーザーの目が最初にどこを向くかを予測します

- 認知活性化分析 — 脳の異なる領域(視覚、感情、記憶、意思決定)に対するコンテンツの刺激強度を評価します

- AI診断エンジン — Gemini視覚モデルによる深い分析を行い、具体的な修正案を提示します

診断ごとに5次元の認知スコア(注意力、視覚的フォーカス、感情的インパクト、行動喚起、記憶の強さ)を生成し、具体的な問題箇所と修正の方向性を明示します。

プラットフォームごとの注意力競争の違い

注意力競争の激しさはプラットフォームによって異なります。これらの違いを理解することは、コンテンツの最適化において非常に重要です:

| プラットフォーム | 注視時間 | 競争密度 | 主要なアテンションアンカー |

|---|---|---|---|

| YouTube ホーム | 0.5-1.2s | 4-8枚が並列 | 顔 + 高コントラストなテキスト |

| Instagram フィード | 0.15-0.3s | 2-4枚が並列 | 彩度 + レイアウト |

| Amazon 検索結果 | 0.2-0.4s | 6-10枚が並列 | 製品の鮮明さ + 白背景 |

| TikTok フィード | 1-3s(動画) | 1枚全画面 | 冒頭3秒 + 動的要素 |

| Instagram (発見タブ) | 0.3-0.8s | 1-3枚 | 美的な質感 + ブランドの一貫性 |

注意:TikTokやInstagramのフィードにおける注意力競争パターンは、他のプラットフォームとは根本的に異なります。これらは全画面没入型であり、競争は「クリックするかどうか」ではなく「見続けるかどうか」で発生します。

理論から実践へ:コンテンツの注意力を高める3つのステップ

上記の科学的原理に基づいた、推奨される最適化フローは以下の通りです:

- 現状を診断する — FlowDxにコンテンツをアップロードし、アテンションヒートマップと5次元スコアを取得して、具体的な問題を見つけます

- 修正を行う — 診断レポートのアドバイスに基づき、ピンポイントで調整します(顔を大きくする、コントラストを上げる、レイアウトを簡素化するなど)

- 効果を検証する — 修正後に再度診断し、前後のスコアの変化を比較して、改善の方向性が正しいか確認します

ほとんどのコンテンツの注意力の問題は、2〜3個の核心的なポイントに集中しています。これらの核心的な問題を修正するだけで、通常は 50-200% のクリック率向上が見込めます。

よくある質問(FAQ)

アテンション・サイエンスとA/Bテストの違いは何ですか?

A/Bテストは「どちらのバージョンが良いか」を教えてくれますが、「なぜか」は教えてくれません。アテンション・サイエンスは、脳の視覚処理プロセスをシミュレートすることで、公開前にユーザーがどこを見てどこを無視するかを予測し、具体的な修正の方向性を示します。両方を組み合わせて使用するのが最も効果的です。まず注意力分析で最適化し、その後にA/Bテストで検証します。

AIが生成するアテンションヒートマップは正確ですか?

FlowDxが使用している DeepGaze IIE モデルは、MIT Saliency Benchmarkにおいて87%以上(AUC指標)の予測精度を誇り、現在公開されている中で最も正確な注意力予測モデルの一つです。このモデルは DenseNet と ResNeXt ディープニューラルネットワークに基づいており、100万人以上の実際の人間のアイトラッキングデータでトレーニングされています。

注意力分析はあらゆる種類のコンテンツに適用できますか?

注意力分析は、静止画(サムネイル、カバー画像、ポスター、広告クリエイティブ、商品画像)に最も効果的です。動画コンテンツについては、FlowDxはフレームごとの分析をサポートしており、動画の中で注意力が最も弱くなる瞬間を特定するのに役立ちます。テキストのみのコンテンツ(記事のタイトルなど)は、現在の分析対象外です。

診断を始める

サムネイル、カバー画像、または広告クリエイティブを FlowDx にアップロードすれば、30秒以内に完全な注意力診断レポートを受け取れます。無料ユーザーは1回お試しいただけます。

参考文献

- Wilson, T. D. (2002). Strangers to Ourselves: Discovering the Adaptive Unconscious. Harvard University Press.

- Itti, L., & Koch, C. (2001). Computational modelling of visual attention. Nature Reviews Neuroscience, 2(3), 194-203.

- LeDoux, J. E. (1996). The Emotional Brain. Simon & Schuster.

- Adolphs, R. et al. (2005). A mechanism for impaired fear recognition after amygdala damage. Journal of Cognitive Neuroscience, 17(7), 1039-1050.

- Linardos, A. et al. (2021). DeepGaze IIE: Calibrated prediction in and out-of-domain for state-of-the-art saliency modeling. ICLR 2021.

- Borji, A., & Itti, L. (2013). State-of-the-art in visual attention modeling. IEEE TPAMI, 35(1), 185-207.